GNOMEのログインのユーザー名を消す。

ユーザー名一覧を消して、ユーザーを指定するようにする。

セキュリティ的な懸念からユーザ名は表示しないほうが絶対に良い。総当りの危険性が減るわけですし。

方法1 lightdm を使う。

sudo apt install lightdm

まぁlightdmでデスクトップ・マネージャを買えちゃうのが一番楽だと思うんですけどね。それをしちゃうと、Xrdpが・・・

方法2 gnomeの設定を変える。

gnome 設定を書き換えて、ログインスクリーンの設定で、ユーザー名一覧を出さないようにする。

/etc/dconf/profile/gdm

gdm の設定を書いて、dconf のプロファイルを有効にします。

cat <<EOF > tmp-gdm user-db:user system-db:gdm file-db:/usr/share/gdm/greeter-dconf-defaults EOF sudo mv tmp-gdm /etc/dconf/profile/gdm

/etc/dconf/db/gdm.d/00-login-screen

ログイン・スクリーン(ログイン画面)の設定を追加する。 ここで、ユーザ一覧の表示を禁止します。

sudo mkdir -p /etc/dconf/db/gdm.d cat <<__EOF__ > tmp-login-screen [org/gnome/login-screen] # Do not show the user list disable-user-list=true __EOF__ sudo mv tmp-login-screen /etc/dconf/db/gdm.d/00-login-screen

update && refresh

dconf の設定を反映する。そして再起動して設定を読み込ませる。

sudo dconf update sudo systemctl restart gdm

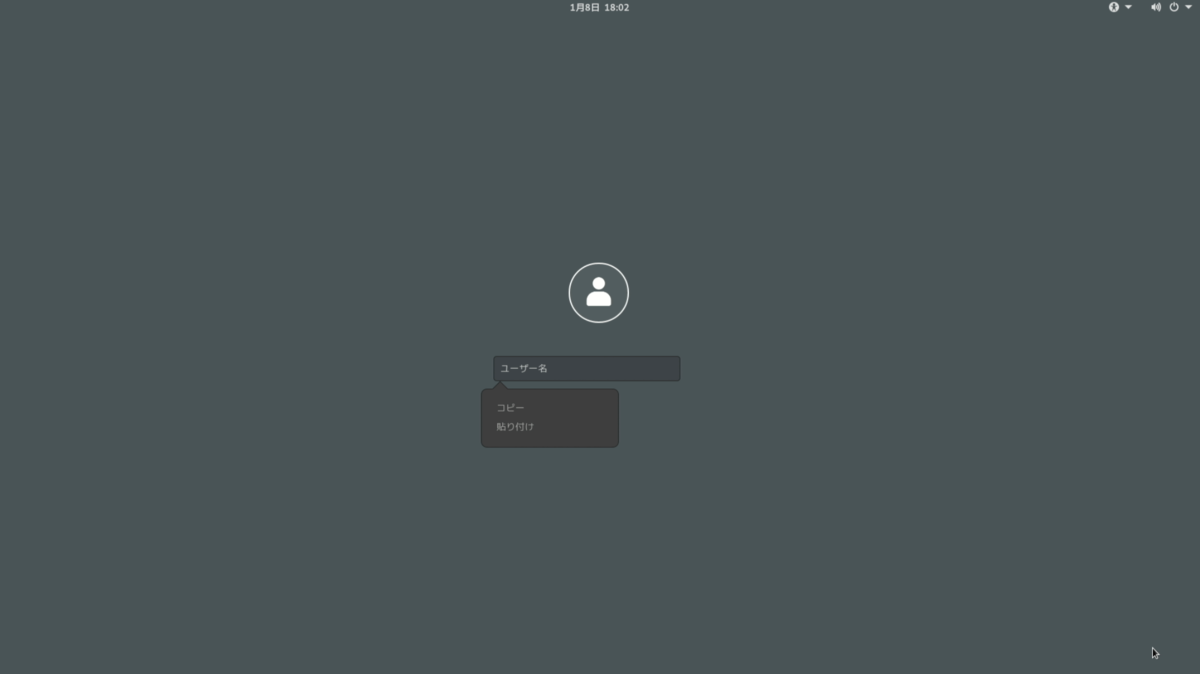

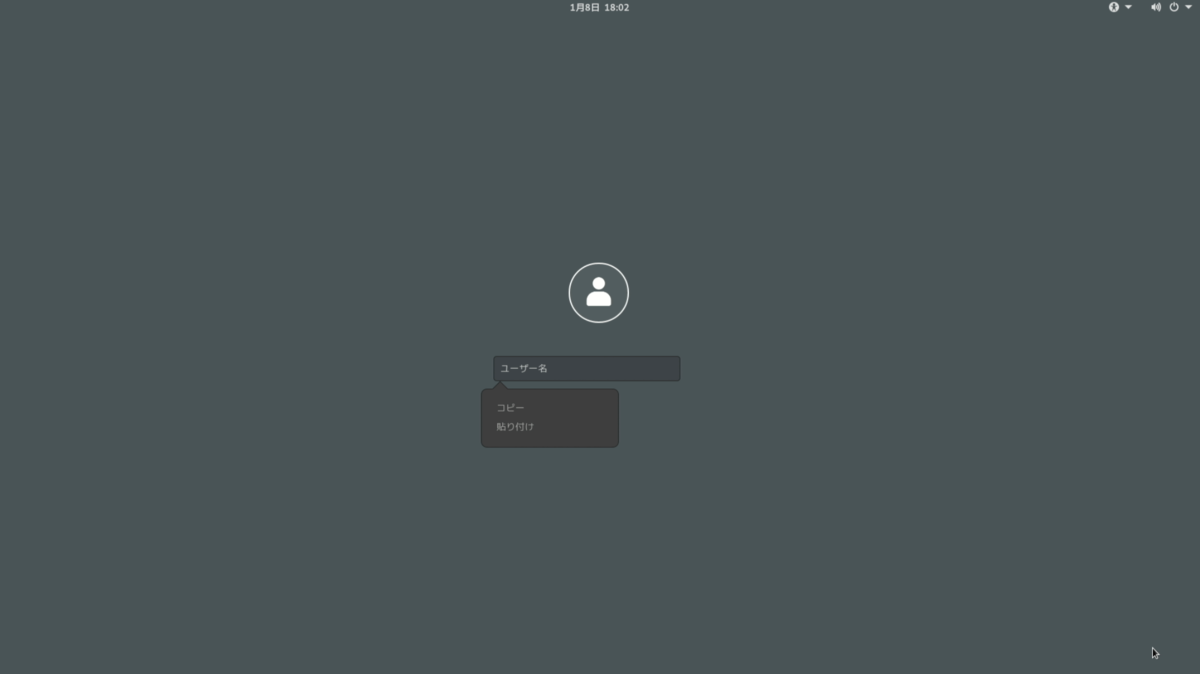

出来上がり

っていうか、なんでこの程度のことがデスクトップの設定からできないんだろう。。。

参考資料

https://help.gnome.org/admin/system-admin-guide/stable/login-userlist-disable.html.en